(En esta larga entrada doy los principios de la fotografía planetaria, así como el procedimiento de fotografiar y cómo editar posteriormente, incluyendo el procesado por lotes).

Desde que tengo uso de razón me apasiona la astronomía, llevo ya años disfrutando de un buen telescopio, siguiendo foros astronómicos y un poquito creo que ya sé. De la misma manera que no hay un tubo (telescopio) perfecto para todo, y esto es un hecho, una opinión muy extendida en los foros es que tampoco hay un astro-fotógrafo para todo; o te centras en la fotografía planetaria o te centras en la fotografía de cielo profundo.

A pesar de ser una opinión muy extendida, no comparto esa opinión. Me encanta la astronomía y disfruto tanto fotografiando una galaxia o nebulosa como un planeta, y sería incapaz de renunciar a uno de esos dos mundos.

Ahora bien, sin renunciar a ningún estilo, a mí me gusta más la fotografía de cielo profundo. Dicen que es más difícil que la fotografía planetaria y que ésta es más agradecida, pero la verdad es que a mí me cuesta mucho más sacar buenos resultados con los planetas.

Pues esta temporada, tras tiempo sin salir a fotografiar, estoy centrándome en la planetaria y creo que he dado un pequeño salto de calidad, tanto que me atrevo a realizar esta entrada contando lo poquito que sé. ¿Qué le parece la siguiente foto?

En ella se ve a Ganímedes, el mayor satélite del Sistema Solar, eclipsando a Júpiter (bueno, ya quisiera ella, la copera de los dioses), tomada el 10 de noviembre de 2023.

¿O qué tal este vídeo de la rotación de nubes de Júpiter? (sin duda, para la foto planetaria, el "hermano mayor" da mucho juego)

De todos modos no se engañe, para tomar estas fotos hacen falta una buena noche y un buen equipo, más un procesado posterior. En esta entrada le voy a dar una serie de indicaciones y consejos para al menos igualar estos resultados, pero ya le digo que de fácil, la fotografía planetaria nada.

En esta entrada, que se antoja larga, voy a seguir el siguiente guión :

- 1 - Los requisitos de la fotografía planetaria

- 1.1. Las turbulencias atmosféricas. El seeing y el El jetstream.

- 1.2. Un buen equipo

- 2. El planteamiento de la fotografía planetaria

- 3. Aspectos a tener en cuenta en fotografía planetaria

- 3.1. La distancia focal

- 3.2. El tubo

- 3.3. La cámara y los aumentos

- 3.4. El tema del fotografiado en color o en monocromo

- 3.5. Los filtros de color

- 3.6. Las lentes Barlow

- 3.7. los dispositivos ADC

- 3.8. La limpieza del tren óptico

- 3.9. La montura

- 3.10. El dispositivo de captura

- 3.11. El disco duro disponible

- 3.12. Apunte alto, pero cuidado con el cambio de meridiano

- 3.13. El apuntado por el buscador debe ser perfecto

- 3.14. El tiempo de aclimatado del tubo

- 3.15. La humedad del ambiente

- 3.16. El enfoque

- 3.16.1 - La máscara de Bathinov

- 3.16.2 - Los dispositivos EAF

- 4. El proceso de fotografiado

- 4.1. La configuración adecuada del equipo

- 4.2. Instalo los aditivos a la cámara

- 4.3. Abrimos el programa de captura de imágenes

- 4.4. La orientación

- 4.5. El enfoque

- 4.5. El fotografiado en sí

- 4.6. El fotografiado (la captura) por lotes

- 4.7. Consejos finales

- 5. El procesado

- 5.1. El procesado con Pipp

- 5.2. El procesado con AutoStakkert

- 5.3. El procesado con Registax

- 5.4. El procesado por lotes o batch processing

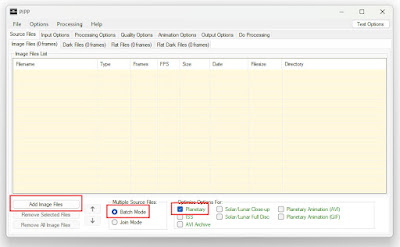

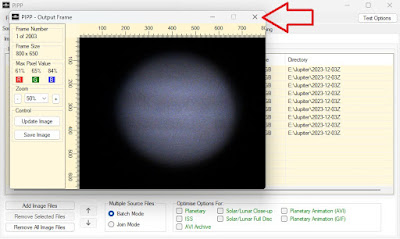

- 5.4.1. Procesado en lotes con Pipp

- 5.4.2. Procesado en lotes con Autostakkert

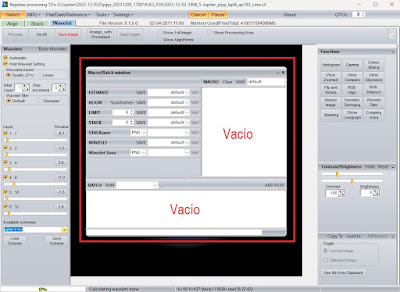

- 5.4.3. Procesado en lotes con Registax

- 6. No descarte la luna

- 7. Intente aprovechar las oposiciones

- 8. Para acabar, no sea duro con sus resultados

1 - Los requisitos de la fotografía planetaria

Para comenzar hacer buena fotografía planetaria, básicamente hacen falta dos requisitos en un principio al 50% (si bien el procesado posterior también tendrá su papel):

- Una noche de observación sin turbulencias atmosféricas

- Un buen equipo

Es evidente que con un mal equipo, por ejemplo sólo con unos prismáticos me va a ser difícil hacer una buena fotografía planetaria (obsérvese que el nombre de la entrada habla de -fotografía- planetaria). Y aunque en un principio ambos requisitos los considero igual de importantes, usted puede tener el mejor equipo del mundo que si la noche elegida hay mucha turbulencia atmosférica, su equipo no valdrá para apenas nada; pero si por contra tiene un equipo medio, pero hace una noche óptima, posiblemente obtenga buenos resultados.

Efectivamente, le doy más importancia a la noche elegida que al equipo, ya que si un telescopio (tubo) que tenga una focal del copón lo pongo a trabajar en una mala noche lo que obtendré será un auténtico finstro, muy grande y ampliado, pero un finstro.

Le pongo otro ejemplo ¿qué le gustaría tener, un Ferrari o un utilitario normal? A mí el primero, pero si intento hacerlo correr por un campo de vacas igual no vale para nada, y un utilitario normal es casi mejor.

Veo que me he lanzado por la calidad de la noche de observación. Hablemos de ella

1.1. Las turbulencias atmosféricas. El seeing y el El jetstream.

Verá, aunque a veces nos fastidie a los aficionados a la fotografía astronómica (especialmente cuando hay un raro eclipse, ocultación, conjunción...) ¡viva nuestra bendita atmósfera! Ahora bien, de día nuestra parte del mundo ha estado recibiendo calor del sol; mucha, mucha radiación solar. Nuestra parte del mundo ha sido una gran roca que se ha calentado, y por la noche, una vez que ya no se calienta al no recibir radiación solar, comienza a emitir calor, y como sabe, los gases calientes pesan menos más que los fríos, por lo que una gran masa de aire caliente comienza a subir, ocupando su espacio otra gran masa de aire frio. Estas vías de aire que suben y bajan hasta que alcancen un equilibrio no siguen unos caminos perfectamente verticales, sino que el viento también influye llevando esto ahora para acá, esto para arriba, esto para abajo... y es un auténtico caos; zonas de aire más ligeras interaccionan con otras más densas, que hacen de lente... es una fiesta invisible la que tenemos sobre nuestros cielos por las noches. Ahora bien, no tan invisible.

A la luz le gusta moverse por el vacío, ahí es donde los fotones alcanzan su mayor velocidad. Por supuesto que los fotones atraviesan la atmósfera, pero esto de ir cambiando de velocidad a medida que van atravesando zonas más o menos densas provoca el fenómeno de refracción, ya sabe...

Y el fenómeno anterior es básicamente el que afecta la luz que nos llega del espacio. Es mucha luz, sí, es toda una autopista de luz la que nos llega especialmente con los planetas, pero también los obstáculos que ha de atravesar esa luz pueden ser muchos, y como veremos eso va a condicionar la forma de trabajar en fotografía planetaria. A las condiciones de observación se les llama seeing, hablando de buen o mal seeing. Efectivamente, esa fiesta invisible que tenemos sobre nuestras cabezas es la que nos va a facilitar o complicar el proceso de fotografiado, y vuelvo a decirlo ¡Bendita atmósfera!

Y dentro de las turbulencias, un tipo de turbulencia muy especial e intensa son unos chorros de aire caliente y frio provocados por el fenómeno anterior de calentamiento y enfriamiento del mar, del suelo... que se mueven por la atmósfera como si fueran ríos. Son tan intensos que poseen nombre propio; se les llama jetstream. En la imagen anterior le pongo estas corrientes en el día de ayer. Estos flujos pueden tardar días o semanas en modificarse y desaparecer.

¿De verdad que todo esto es tan terrible? Para situarnos, le pongo ejemplos de diferentes vídeos de fotografía planetaria captados en diferentes condiciones de turbulencias.

Ejemplos de turbulencias pequeñas, buen seeing

- Planeta Júpiter

- Los montes Jura y Sinus Iridum

- La gran Conjunción Júpiter-Saturno de 2020

Ejemplo de turbulencias moderadas, seeing moderado

- Planeta Marte

Ejemplo de grandes turbulencias, mal seeing

- Planeta Venus

Ya sabemos qué es la turbulencia atmosférica. ¿cómo nos afecta? Pues si la atmósfera está muy inquieta, además de ser más difícil enfocar (proceso fundamental en la foto planetaria), la imagen no dejará de moverse y deformarse, siendo más difícil captar detalles o incluso el disco del planeta. Por contra, si la atmósfera está más tranquila, será más fácil trabajar a gusto. Hay que tener en cuenta que un planeta prácticamente lo vemos como una estrella de grande, como un punto, por lo que se trata de ampliar todo lo que podamos, y esa autopista de luz de señan suya que nos llega no deja de ser una línea muy fina dentro de la atmósfera, muy susceptible de ser afectada. Eso sí, cuanto más alto estemos, menos atmósfera encima y menos turbulencia. Lo peor de lo peor, mi caso, estar al nivel del mar.

Por otra, la fotografía planetaria y la de cielo profundo no tienen casi nada que ver además de que se hacen por la noche ¿Esta turbulencia no afecta tanto a la fotografía de cielo profundo? Pues también, pero como la fotografía de galaxias y nebulosas no amplía tanto lo que se pilla en la foto (son objetos bastante grandes pero muy tenues), no se nota tanto este movimiento atmosférico, ya que no se trata de ampliar, sino de recoger luz, pero al ampliar un objeto puntual... vaya si se nota.

Puede encontrar la situación a tiempo real, y una predicción a futuro del jetstream en el siguiente enlace. Como siempre, a cuanto más largo plazo sea la previsión, mayor error.

Otra aplicación útil para ver el estado atmosférico, no sólo el jetstream, es la página web de Meteoblue, en particular el siguiente enlace.

Al ver esta página nos damos cuenta que las turbulencias se dan por capas de altura, especialmente en las capas más bajas (lo que tiene su lógica, al haber más aire y estar más cerca del suelo, siendo más sensible a los cambios de temperatura). Los afortunados que vivimos al nivel del mar disfrutamos también de las mayores turbulencias; a medida que nuestro lugar de observación está a mayor altura, menos capa de aire tenemos encima y menores turbulencias.

Dicha aplicación también nos hace una tabla de las condiciones atmosféricas o

seeing desde nuestro lugar de observación en el siguiente

enlace.

Dicha tabla, especialmente la zona no sombreada, nos da información de las condiciones de observación actuales y una predicción a futuro

Vamos a ir acabando este apartado. ¿Sabe el significado del verbo titilar? Se lo voy a explicar brevemente. Si usted mira ahora al cielo y ve a Júpiter brillando a lo largo de toda la noche (noviembre de 2023, poco después de su oposición), este planeta se ve aparentemente como una estrella, sin duda más brillante que el resto, y si me apura, ahora que lo dice, se ve como un disco minúsculo. De hecho... ¿sabe por qué las estrellas centellean o titilan y los planetas normalmente no? Porque están tan lejos que las vemos como puntos, mientras los planetas, aunque no nos demos cuenta de ello, los vemos como pequeños discos. Esto es lo que intenta representar la imagen siguiente.

Si la atmósfera viene movida ¿a qué va a afectar más? ¿Al pequeño disco o al puntito? Lógicamente al punto (estrella), mientras los planetas apenas centellearán (esto es algo que se decía para distinguir los planetas de las estrellas; los planetas no titilan). Pues digamos que si lo habitual es que los planetas no titilen y las estrellas sí, habrá noches muy buenas (en lo que a turbulencias se refiere) en que las estrellas apenas titilen, y por contra, noches muy malas en las que titilen los planetas.

Sinceramente, las noches de turbulencia moderada o grave olvídese de intentar foto planetaria. Todo le costará más y los resultados serán peores. Busque un planeta normalmente no muy brillante, por ejemplo Saturno o Marte (Venus y Júpiter suelen ser un cañón de luz). Si lo ve titilar... no es una buena señal.

Ya le he dado varias herramientas para calcular cómo va a estar de plácida la noche sin sacar el equipo. Vayamos ahora con éste.

Por cierto, habrá observado que los vídeos anteriores no poseen color. Todavía quedaría hacerles un procesado adecuado para conseguir de los citados vídeos unas fotos medio decentes, entre ellas el proceso de debayerizado.

1.2. Un buen equipo

Lo siguiente que necesitamos para hacer buena fotografía planetaria es un buen equipo; una buena montura, un buen tubo y una buena cámara esencialmente.

La verdad es que en el apartado 3 voy a hablar de los requisitos físicos, y otros aspectos como el tiempo de aclimatado, las lentes Barlow, la limpieza del tren óptico, intentar fotografiar objetos cenitales, el trascendental enfoque... por lo que la parte del buen equipo la voy a dejar para el punto tercero en el que además de los requisitos técnicos voy a dar otro tipo de aspectos para tener en cuenta.

2. El planteamiento de la fotografía planetaria

Insisto, yo en esta entrada hablo de fotografía planetaria. Coger unos prismáticos o un pequeño telescopio y ver a Júpiter o la Luna está muy bien, lo recomiendo, pero yo le voy a dar más, en esta entrada le voy a decir cómo fotografiarlos.

Lo primero que debe saber es que hacer una fotografía planetaria no consiste en hacer una foto y disfrutarla. En primer lugar porque hace falta tener los medios para poder ampliar mucho la imagen. Por ejemplo, si conecto una cámara reflex a un telescopio reflector de 1000 mm, una focal bastante notable, para intentar pillar a Júpiter, este es el deprimente resultado.

En la primera imagen, muy sobreexpuesta para captar los satélites galileanos se ve Júpiter y los citados satélites. Si reduzco la exposición para captar las bandas principales de nubes, pierdo los satélites (de esto de los diferentes brillos de los objetos en una misma fotografía también tendré que hablar). En ambos casos, la imagen se ve muy pequeña y no posee detalles.

He de irme entonces a otra cámara que me permita ir a por más aumentos (en el siguiente apartado hablaré de ellas) y hago diferentes fotos a Saturno y Venus. Este es el resultado con una cámara mejor (después haré una comparativa de cámaras).

Igual no se aprecia demasiado, pero todas las fotografías son distintas. Son el resultado de diferentes momentos de la turbulencia atmosférica, por lo que si en el momento de la foto apenas había distorsión de la imagen, la foto estará bien. Si había distorsión atmosférica, la foto estará mal. Vuelvo a ponerle unos de los vídeos del principio, el de mal seeing.

Así por ejemplo, de Saturno, la mejor foto es la A, y la peor la C. En cuanto a Venus, quizás la c y la e son aquellas cuyo disco tiene forma más parecida a una circunferencia

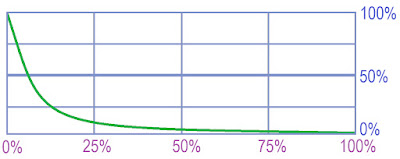

Pero esto es terrible; igual hago 200 fotos y sólo son perfectas una decena de ellas, a más turbulencia menor porcentaje de fotos óptimas. Además, la turbulencia es caprichosa, igual encuentro un intervalo de 5 segundos en el que la atmósfera se comporta bien, seguido de 20 minutos en el que es un caos.

Pero esa es la idea, no sólo tomar 200 fotos, sino que si pueden ser 2000, mejor, y si pueden ser 8000 aún mejor. A este conjunto de fotos se le llama vídeo, y lo que hacemos a posteriori es quedarnos con los mejores fotogramas y apilarlos, unirlos en uno sólo. De la importancia del apilado hablo en esta

entrada.

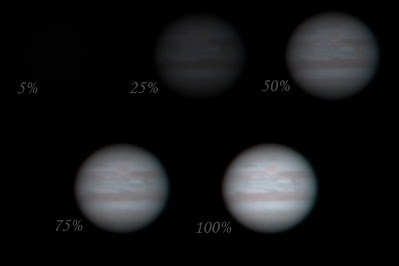

Por ello, la forma de trabajar en fotografía planetaria es la siguiente (se llama también técnica del lucky frame o lucky imaging); vamos a buscar el equipo que nos permita ver los objetos lo más grande posibles sin perder la nitidez, vamos a grabar vídeos, cuantos más fotogramas mejor, desecharemos los peores y nos quedaremos con los mejores. Estos mejores fotogramas los apilaremos con programas adecuados, y tendremos una sola foto óptima. Le doy otro ejemplo

En la foto anterior, en una noche de muy, muy buen seeing, de un vídeo de unos 90 segundos y 1750 fotogramas, captura de la izquierda, tras quedarme con los 40% mejores y apilarlos, conseguí la foto de la derecha.

Y esto de sin perder la nitidez es importante. No se trata de aumentar todo lo que le dé su equipo, sino que su equipo, en unas condiciones ideales de seeing le dará hasta tantos aumentos. Sobrepasarlos lo que le traerá es ruido. Por ejemplo, si toma un libro con sus manos habrá una distancia a la que usted lea de manera óptima. Si encontrada esa distancia usted acerca y acerca el libro a su cara, verá las letras más grandes, sí, pero más borrosas. La visión era mejor cuando el libro estaba más alejado pero aunque pequeñas, veía bien las letras.

Pues así funciona la foto planetaria; vamos a grabar vídeos de los planetas, el Sol, la Luna... y cuanto mejor seeing, mejor enfoque y mayor número de frames, mejor, para después resumir toda esa señal en una sola foto; básicamente, comprimir vídeos de un par de minutos en una sola imagen.

Una cosa más; aunque en este caso es fácil sustituir la palabra frame por la palabra fotograma, buscando una mayor fluidez en la lectura de esta entrada me decantaré en su mayoría por la primera opción, a pesar de no estar admitida por la RAE.

Bueno... así funciona la fotografía planetaria, y ahora vamos a ver qué necesitamos.

3. Aspectos a tener en cuenta en fotografía planetaria

En este apartado voy a hablar de varios temas que son muy importantes en la astrofotografía, como son la distancia focal, la montura, el tubo, los aumentos, el color, el enfoque, dónde apuntar...

3.1. La distancia focal

Para fotografiar la luna, bastaría con un trípode y una cámara reflex con teleobjetivo. Los teleobjetivos tienen una escala que es la distancia focal y se mide en milímetros; $10-18$, $18-200$, $70-300$ mm. Si giramos el teleobjetivo, lo extendemos, haciéndolo más largo, nos vamos a las distancias mayores, si lo dejamos en la posición más comprimida, la menor. Esto hará que trabajemos con más o menos aumentos. Le pongo un ejemplo de una misma cámara trabajando a distintas distancias focales.

Ese es el efecto de la distancia focal (después al hablar de los tubos me vendrá bien). A mayor distancia focal, el campo de visión (FOV) es más pequeño, pero los objetos se ven también más grandes.

Por ello, para fotografiar la Luna, me basta con un trípode y un teleobjetivo, un 200 o un 300mm, elegir los parámetros de apertura y exposición adecuados y este sería el resultado. Ya estaríamos haciendo fotografía planetaria, en este caso del eclipse parcial de luna del 27 de octubre de 2023 en una foto a 300mm, f/3.5, ISO 100 y 1/250s de apertura.

A pesar de tener por ejemplo un teleobjetivo a

300mm, no espere verlo todo muy muy grande, para eso nos haría falta un tubo de telescopio. Efectivamente, piense que los planetas se ven de grandes como estrellas, y mirando la anterior foto de la Luna con el tamaño que usted sabe que posee nuestro satélite ¿Qué tamaño tendría una estrella en comparación con la luna? Necesitamos ir por más focal, pero en esta

entrada le doy sugerencias de más cosas que se pueden fotografiar también sin telescopio.

Dicho esto, vamos a partir de que sí tenemos un telescopio para echarnos a la boca.

3.2. El tubo

Un telescopio consta de tres partes principales, el trípode, la montura y el tubo. El tubo es la parte óptica del telescopio que posee lentes o espejos. Yo tengo un telescopio que posee 3 tubos distintos, cada uno de los cuales posee sus ventajas e inconvenientes. ¿Me encantaría tener un Ferrari? Sí, pero para usar en autopista, para andar por caminos de tierra no, para eso mejor un $4\times 4$, y para moverme en ciudad un coche lo más pequeño posible. Lo mismo va a pasar con los tubos, según el tipo de fotografía que deseemos nos interesarán de un tipo o de otro.

Volviendo al apartado anterior, usted ve los planetas a simple vista como si fueran estrellas, por lo que se trata de aumentar mucho, y de aquello que parece un punto sacar detalles como fases, anillos, satélites o nubes que no se ven a simple vista. Para todo ello necesitamos trabajar con una focal grande, lo que nos va a permitir verlo todo más grande.

Yo tengo un refractor de $8\,cm$ de abertura o diámetro focal, mi ED72, con el que estoy muy contento, al ser muy luminoso, pero que posee una focal de 420, sólo algo superior a algunos teleobjetivos que se conectan a las cámaras reflex.

También tengo un reflector de $20\,cm$ de abertura focal y distancia focal de 1000. Este es mejor que el anterior para fotografía planetaria, ya que además de la mayor distancia focal, al tener una mayor abertura va a captar más detalles al tener un mayor poder de separación mayor.

Pero la palma para fotografía de planetaria se la lleva mi Maksutov, también de unos $20\,cm$ de diámetro focal (exactamente 18), pero una distancia focal de 2700. Es más oscuro que los anteriores; para captar cualquier objeto necesito mayor tiempo de exposición, pero también los objetos se ven más grandes. Lo de la menor luminosidad no es necesariamente malo; los planetas, el sol o la luna suelen ser muy brillantes y no suele hacer falta mucho tiempo para captarlos.

Le pongo un ejemplo de poder de separación. La estrella más brillante del firmamento, vista desde la Tierra, es Sirius, en la constelación del Can Mayor, cerquita de Orión. En realidad Sirius es Sirius A, ya que es un sistema doble formado, que se sepa (hay dudas de que sea un sistema triple), por al menos Sirius A, una estrella blanca de la secuencia principal que posee el doble de masa y diámetro del Sol, y por Sirius B, una enana blanca del tamaño de la Tierra y la masa del sol, y que curiosamente en su momento fue la más masiva de las dos. Ambas están situadas a unos 8'6 años luz de la Tierra.

Pues resulta que Sirius B, la menos brillante y menos masiva, da una vuelta alrededor de Sirius A a lo largo de 50 años en una órbita elíptica, y que ahora prácticamente están a la máxima distancia entre sí, unas 20 UA, unos tres mil millones de kilómetros o la distancia de nuestro Sol a Urano.

|

| Extraído de Wikipedia |

El tema es que aprovechando este mayor alejamiento, anoche intenté captar a Sirius B. El problema no es tanto la distancia, sino que hay tanta diferencia de brillo entre una y otra estrella que para captar la débil hay que subir mucho el tiempo de exposición de ambas, con lo que la brillante queda muy sobre-expuesta y lo habitual es que se coma a la débil. Con ustedes, Sirius A y B. ¡A la primera!

Pues esto es un ejemplo de poder de separación; independientemente del problema del brillo que hace que a Sirius A no lo vea como un punto sino como un disco al haber exagerado la exposición, mi tubo Maksutov me permite separar a 8'6 años luz de distancia dos estrellas que están separadas como del Sol a Urano.

A la hora de elegir el tubo para planetaria, ya sea visual y fotografía, a mayor distancia focal mejor, y fíjese que digo elegir. Un tubo para fotografía planetaria no es el mejor para cielo profundo, en el que prima la luminosidad sobre la distancia focal.

Ahora bien, verlo todo más grande también tiene su coste si las turbulencias son grandes. Para acabar de entender lo relacionado con el poder de separación y las turbulencias le recomiendo leer la siguiente

entrada relacionada con el concepto de

arc-pixel.

3.3. La cámara y los aumentos

Seguimos hablando del concepto de focal y me voy a permitir una clase elemental de óptica. La cámara y los aumentos están relacionados, y mucho ¿sabe cómo funcionan los aumentos en un telescopio? Consideremos el esquema básico

Si bien cada tipo de tubo de astronomía tiene su esquema (el anterior se corresponde a un refractor), la idea es la misma; el objetivo o espejo principal posee un diámetro $D$, le llega la luz, y hace converger ésta hasta el foco, llamamos $f_1$ a la distancia focal del objetivo al foco, tras el foco la imagen se recupera invertida en el ocular, de diámetro $d$, y de distancia focal del foco al ocular $f_2$, todo en milímetros.

Al mirar por el ocular (pequeño) podemos ver toda la luz que pasaba por el objetivo (mayor), y esto supone aumentar.

Ya que estamos con óptica, digamos que la relación focal de un telescopio o focal, $F$, es igual a la distancia focal al objetivo $f_1$ entre el diámetro del objetivo

$$F=\frac{f_1}{D}$$

Como vemos, es un concepto que no depende del diámetro del ocular, y cuanto más baja es la focal, el telescopio es más luminoso.

Por ejemplo, mi reflector posee una distancia focal de $1000\,mm$ y una apertura de $200\,mm$, por ello posee una focal de

$$F=\frac{1000}{200}=5$$

Lo que lo convierte en un tubo muy luminoso.

Seguimos con la clase de óptica elemental. Vamos ahora con los aumentos. En las condiciones anteriores, los aumentos que da un telescopio se corresponden con la fórmula, siempre todo en milímetros

$$Aumentos=\frac{f_1}{d}$$

Así por ejemplo, si a mi reflector de apertura focal de $200\,mm$ y longitud focal de $1000\,mm$ le pongo un ocular de $25\,mm$ de diámetro, estaría trabajando a

$$Aumentos=\frac{1000}{25}=40$$

por contra, si a mi reflector de apertura focal de $200\,mm$ y longitud focal de $1000\,mm$ le pongo un ocular de $4\,mm$ de diámetro, básicamente una lenteja, estaría trabajando a

$$Aumentos=\frac{1000}{4}=250$$

Esto es, a una misma distancia focal, cuanto más pequeño es el ocular, más aumentos.

Vale, todo esto está muy bien. Pero nosotros no vamos a hacer visual. No vamos a mirar por un ocular, sino que vamos a conectar del tirón una cámara de fotos que no posee ocular al telescopio ¿entonces?

Pues entonces entra en juego el tamaño del sensor, en particular el concepto del tamaño de pixel

Por ejemplo, mi cámara reflex EOS 80D posee un tamaño de píxel de $3'7\,\mu m=3'7\cdot 10^{-6}m=0'0037\,mm$

Mientras, una cámara para planetaria, por ejemplo la ZWO 462-MC, posee un tamaño de pixel de $2'9\,\mu m=2'9\cdot 10^{-3}mm=0'0029\,mm$

Esto es, el tamaño del pixel en una cámara para planetaria es inferior al de una cámara reflex como mi EOS 80D, y por esto las cámaras reflex no son las mejores para fotografía planetaria, al dar menos aumentos.

Doy un ejemplo muy, muy revelador de una misma noche con el mismo tubo en igualdad de condiciones. Una cámara reflex en comparación con una cámara especializada en fotografía planetaria.

En ambos casos usé un reflector con una focal de 1000; en la parte de la izquierda, una foto de la luna creciente con la citada CANON EOS 80D, que posee un campo de $6000\times 4000$ píxeles; arriba a la derecha, la foto que hice la misma noche a la misma fase lunar con la ZWO 462MC. Como se ve, la diferencia de usar una cámara con un tamaño de píxel algo menor, 2'9 vs 3'7, da un mayor aumento de la imagen.

Lo afirmado anteriormente es indiscutible, pero vamos a hacer una pequeña trampa; voy a igualar el tamaño de lo que se ve en la ventana (realmente lo importante son los píxeles que ocupa cada imagen), y voy a comparar entonces sus tamaños. De nuevo uso las mismas cámaras y el reflector de focal 1000, y pongo otro ejemplo con un objeto más pequeño que la luna.

En la primera imagen se ve una foto de Júpiter y 3 de sus satélites hecha con una cámara EOS 80D con sus $6000\times 4000$ píxeles.

Se ve que en la cámara reflex, tener 6000x4000 píxeles está muy bien para irse al campo y pillar objetos grandes, pero para capturar objetos que son muy pequeños que pueden tener unos 15-20 píxeles de largo, pues como que hay mucho espacio desperdiciado. Vamos con la otra cámara.

La misma noche y con el mismo tubo que la foto anterior, una foto hecha con la cámara ZWO 462MC, que permite un campo máximo de $1936\times 1096$ píxeles. Se ve que tener menos píxeles no es una desventaja, ya que el planeta, pequeño se ve más grande relativamente porque el campo de visión es más pequeño.

Pero lo ideal sería comparar los tamaños si ambas cámaras trabajaran al mismo tamaño de pixeles, aquí está la trampa, por ejemplo que las dos imágenes estuvieran a $6000\times 4000$. Dicho y hecho, para poder comparar mejor, hago que la imagen de la segunda cámara también posea 6000 píxeles de base. Y yo pregunto ahora. ¿En cuál de las fotos el planeta se ve más grande? (en este caso es sólo ver con que cámara se ve todo más grande; los píxeles no pueden aumentarse así como así).

Veámoslo de otra forma, acerquemos los resultados de ambas cámaras (trabajando con un mismo tamaño de pantalla ficticio de $6000\times 4000$ para poder comparar mejor). Esto encantado con mi EOS 80D... Pero ¿Qué cámara prefiere usted para fotografía planetaria?

Otro aspecto del que no he hablado es que una cámara reflex no permite quedarme con un trozo de la imagen y desechar el resto; las cámaras para fotografía planetaria (lo veremos cuando hable de la captura, sí permiten trabajar con una ROI (Region Of Interest) o FOV (Field of Vision) elegida por nosotros en cuanto a tamaño)

Por ello, para fotografía planetaria no se usan cámaras reflex, sino unas especiales. Le muestro una imagen de las más extendidas (yo tengo un par de ellas).

De estas populares cámaras de la marca ZWO (Zhen Wang Optics) hay básicamente tres tipos; las que sirven para guiado, que son monocromas y más económicas (los otros dos tipos también sirven para guiado), las de cielo profundo (que son las más caras y vienen refrigeradas mediante efecto Peltier), y las de planetaria como la de la imagen anterior.

Si decide comprarse una, uno de los parámetros principales es el tamaño de pixel (hay más, como el de la efectividad cuántica, pero ya me desviaría demasiado del tema principal), y otro muy lógico, los fps (frames por segundo). Efectivamente; la cámara hace foto tras foto y las pega una detrás de otra en un vídeo. Si nuestra cámara por ejemplo es capaz de captar 30 fps, cada segundo añadirá 30 fotogramas al vídeo, y si lo dejamos abierto 100 segundos, obtendremos un vídeo con 3000 fotogramas.

Ahora bien, si nuestra cámara es capaz de registrar digamos 50 fps, en un vídeo de 100 segundos registrará 5000 fotogramas; habrá más fotogramas buenos para quedarnos al procesar.

De todos modos, aquí habrá que tener en cuenta que el número de fps dependerá del tamaño del FOV (Field Of Vision). Imaginemos, izquierda, que el planeta es una parte pequeña de la imagen, pero queremos captar un vídeo con una imagen amplia, FOV grande, entonces, aunque el fondo mayoritario sea negro, habrá que registrar todo ese fondo negro, por lo que en un segundo capturaremos pocos fotogramas

Ahora bien, si hacemos un recorte de la pantalla completa, en color rojo, de forma que lo que nos interesa esté dentro de ese recorte, habrá que grabar menos espacio de la vida real, y en un mismo segundo dará tiempo de registrar más frames.

Por ello, el número de fps es indicador de la cámara, cuantos más fps mejor, pero también dependerá de lo que capture (los programas de captura le permitirán elegir el FOV que usted desee) y también de la velocidad de su ordenador o similar a la hora de grabar datos; si su cámara es rapidísima pero su ordenador tarda mucho en grabar los datos en el disco duro, llegará un momento en el que la RAM de su ordenador se llenará y su cámara no almacene temporalmente los fps que pudiera, sólo los que pueda grabar. Es como si estoy recogiendo fruta, subido en un árbol, y en un minuto puedo coger 10 manzanas para pasárselas a mi ayudante. Si éste tiene la capacidad de dejar 20 por minuto en la cesta, bien, pero si mi ayudante sólo puede dejar 5 manzanas por minuto en la cesta y yo intento darle 10, algo acabará fallando, no llegando todas al cesto.

Ya sabe, si opta por estas cámaras, que sean específicas de planetaria, no reflex, y que tengan un fps máximo alto (los tamaños de píxel suelen ser similares). Ahora bien... ¿cámara monocroma o color?

3.4. El tema del fotografiado en color o en monocromo

La verdad es que escribir este tipo de entradas tan largas es un problema, ya que no dejan de surgir ramificaciones. Mi idea es no desviarme mucho del camino principal, pero también hay que informar de los caminos secundarios, y como dijo Robert Frost, eso a veces marca la diferencia.

Verá... las cámaras monocromas son mucho mejores que las cámaras a color; poseen una mayor definición porque no emplean sus recursos a captar el color, sólo a captar los detalles.

En efecto, las cámaras a color (vuelvo a remitirle a la siguiente

entrada) tienen su sensor compuesto por una matriz de Bayer en la que según como se combinen los sensores R, G, B (

red, green, blue) se llamarán de una forma u otra, por ejemplo RGGB significa que en ese orden, celda de 4, vienen el rojo, verde, verde y azul.

Entonces, las celdas de color rojo bloquean el color rojo; no lo registran sino que el rojo se queda registrado en las celdas que bloquean el color verde y azul. A su vez el color verde se registra en las celdas roja y azul, y lo mismo sucede con el color azul. Y según la información que queda registrada en cada celda, el programa adecuado determina cuáles son los colores que incidieron en la matriz de Bayer. En vez de usar un pixel para recoger la señal, hay que usar $2\times 2=4$ para recoger la señal y el color, y por ello las cámaras en blanco y negro recogen una mejor señal.

Este proceso es muy efectivo, pero requiere mayor tiempo de procesado y se pierde información. Los diferentes píxeles pierden parte de su efectividad porque además de indicar a cuáles les llega más o menos luz han de emplearse para registrar colores, no siendo entonces tan efectivos para registrar luz.

Pero claro, tener una cámara monocroma tiene la ventaja clarísima de que las imágenes son más nítidas, pero el inconveniente de que las imágenes están en escala de grises. Para corregir eso hay una técnica consistente en tomar tres vídeos distintos, uno con filtro rojo (que no deje pasar la luz roja), otro con filtro verde (idem) y otro con filtro azul (idem). Al combinar adecuadamente las tres imágenes vamos a obtener la imagen con sus colores naturales, y a priori con una mayor definición.

Ahora bien. Imagínese el trabajo que supone eso; si por ejemplo no podemos capturar un vídeo de Júpiter de más de 2 minutos o las nubes pierden definición, supongamos que un vídeo de 120 segundos, ahora habría que capturar 3 vídeos de 40 segundos, cada uno con un filtro de color, por lo que se ganaría definición, pero también mayor estrés en la captura; todo debería estar perfectamente sincronizado.

Para ayudarle con su tarea de cambiar los filtros si este es su camino, existen unas ruedas portafiltros, incluso automatizadas, que realizarán esa tarea por usted (por ejemplo con la plataforma ASIAIR de ZWO); 40 segundos al rojo y se pasa al filtro verde, otros 40 segundos y se pasa al azul y otros 40 segundos.

Y aquí interesaría que en esos 40 segundos usted grabe los vídeos y les ponga nombre según el filtro usado, para después procesar oportunamente y combine los 3 colores.

Como ve, es todo un trabajo. A priori mejores resultados, pero que requiere de más equipo (los filtros, la rueda porta-filtros y la plataforma que gestione la rotación de los mismos), por lo que para empezar le recomiendo que se compre una cámara a color que lo hará todo más sencillo.

3.5. Los filtros de color

Además de para cámaras monocromas, a las cámaras de color también se le pueden poner filtros que aumenten ciertos detalles de los planetas. Básicamente si en una atmósfera predomina un color, al poner un filtro de ese color a la cámara planetaria u ocular anularemos ese color que viene del planeta, potenciando otros colores

Los filtros de color se caracterizan por tener un número asociado. Los más usados son los siguientes (extraído de Astroshop.es)

- Violeta W4

- Mejora los anillos de Saturno y sus contornos, así como las nubes de la atmósfera de Venus.

- Azul oscuro W38A

- Mejora Júpiter, Saturno y Marte. Potencia las bandas de nubes de Júpiter y Saturno, intensifica las fases de Venus y destaca las colas de polvo de los cometas.

- Azul W80A

- Mejora la visibilidad de Júpiter, Saturno y Marte. En Venus también potencia las estructuras y mejora la visualización de sus fases.

- Azul claro W82A

- Incrementa el contraste en la mayoría de los planetas, sobre todo en Júpiter y Saturno (especialmente para las bandas de nubes). Mejora la visualización de las fases de Venus. Permite ver los casquetes polares de Marte.

- Verde W56

- Destaca la Gran Mancha Roja de Júpiter. En telescopios de gran apertura permite ver las nubes blancas de Saturno y distinguir mejor sus anillos. Aumenta el contraste para observar la Luna. Permite visualizar las fases de Venus.

- Amarillo-verde W11

- Incrementa el contraste en Marte y destaca la División de Cassini en Saturno. También es apto para Júpiter.

- Verde oscuro W15

- Intensifica los detalles y las nubes de Marte. Destaca la Gran Mancha Roja de Júpiter. Aumenta el contraste en la Luna. Reduce la franja azul que aparece en los refractores acromáticos.

- Rojo oscuro W29

- Aumenta el contraste en la Luna. Bloquea la luz de la parte azul del espectro lumínico, por lo que permite ver Venus y Mercurio durante el día. Permite ver los casquetes polares de Marte.

- Rojo W25

- Similar al filtro anterior.

- Rojo claro W23A

- Similar al filtro anterior.

- Naranja W21

- Mejora las tormentas de polvo de Marte, estructuras en Júpiter y Saturno, permite visualizar mejor las fases de Mercurio y también permite observar detalles en Urano.

- Amarillo W12

- Mejora las nubes y tormentas de polvo en Marte y estructuras en Júpiter. Intensifica los detalles y las nubes de Marte. Destaca la Gran Mancha Roja de Júpiter. Aumenta el contraste en la Luna. Reduce la franja azul que aparece en los refractores acromáticos.

A la hora de adquirir un filtro, además de la información anterior, tendremos también en cuenta si es para adaptar a un ocular o salida de cámara de 1.25'' (lo habitual), o de 2'' (ya más raro y en general más caros). No es una pieza necesariamente cara, aunque la calidad hay que pagarla, y tampoco hay que tenerlos todos.

3.6. Las lentes Barlow

Hemos visto anteriormente que la distancia focal es un elemento muy importante a la hora de la fotografía astronómica; a mayor distancia focal tendremos un campo de visión más pequeño pero también mayor aumento (que es lo recomendable).

Como efectos colaterales de una mayor distancia focal, que la imagen se hace más oscura por lo que requiere un mayor tiempo de exposición, y que la imagen es más sensible a las turbulencias.

Una lente de Barlow es una pieza como la anterior en la que la parte de la derecha se introduce en el porta ocular del tubo, y en la parte de la izquierda, más ancha, se introduce el ocular o la cámara, y el resultado es que alarga el recorrido de la luz del tubo, por ejemplo duplicando la distancia focal.

En la imagen anterior, es una Barlow $2\times$, pero las hay desde $1.5\times$ hasta $5\times$. Si por ejemplo a un tubo de una distancia focal de 1000 le añado una Barlow $2.5\times$, en ese tubo tendría ahora una distancia focal de 2500

Eso a priori no es malo, pero ya digo, trabajar a una focal mayor supone una mayor oscuridad y ser más sensibles a las turbulencias atmosféricas, entrando un parámetro nuevo... estamos metiendo una nueva lente en el tren óptico, por lo que si la lente no está perfectamente limpia, nos generará parásitos en la imagen final (de la limpieza del tren óptico hablaré en el siguiente apartado).

Así que si va a adquirir una Barlow, no le digo que se compre la más cara del mercado, pero que tampoco se compre la más barata que vea en plataformas de compra de internet. Esta pieza, si la adquiere, es importante que sea buena, por lo pronto de vidrio y no de un plástico que lo imite, por lo que consulte a un profesional de una tienda especializada.

Para acabar, a una lente Barlow, en vez del ocular le puede conectar otra, y si son por ejemplo $2\times$ y $3\times$, tendrá un $6\times$, y si a este sistema le conecta una $1'5\times$, tendrá ahora un $6\times 1'5\times=9\times$, viéndolo todo más grande, sí, pero añadiendo más elementos al tren óptico (apartado 3.8) y seguramente en vez de tener una imagen nítida, obtenga algo borroso que encima se salga de su pantalla. Las lentes Barlow son una importante herramienta, sí, pero para usar con moderación, e igual una noche con mal seeing no se admita ni una simple $2\times$.

3.7. Los dispositivos ADC

Estos dispositivos ADC (Atmospheric Dispersion Corrector) son interesantes en su planteamiento, pero vaya por delante que yo (aún) no poseo ninguno; ya tengo bastantes cosas que me hacen falta, pero a pesar de no tenerlo (y tampoco estar muy interesado), en esta entrada he de hablar de ellos.

Como sabrá, Newton descubrió que la luz blanca está compuesta por señales a diferentes longitudes de onda, que en el vacío viajan juntas al poseer la misma velocidad, pero que al pasar por un prisma, por un proceso de refracción, al tener distintas energías se iban separando sus velocidades y se podían ver las diferentes señales que componían el espectro visible, del violeta al rojo.

Este proceso, en menor medida, se da también en la atmósfera, produciéndose cierta refracción, tanto mayor cuanto los objetos están más bajos en el horizonte al atravesar una capa mayor de aire, y por ello la luz de un planeta no nos llega blanca, pura y concentrada, sino descompuesta y dispersa. Este es el motivo por el que funcionan tan bien las cámaras monocromas; en un principio se desentienden del color y son los filtros azul, rojo y verde los encargados de recoger por separado esos tres colores que están dispersos para combinarlos después.

Pues lo que hacen los dispositivos ADC es intentar compensar esa dispersión, y volver en la medida de lo posible a concentrar esas señales en una señal blanca lo más pura y concentrada posible. Para ello, los dispositivos ADC poseen unas lentes internas que oportunamente orientadas mediante los controles grises de la imagen, corrigen esa dispersión de los colores, especialmente cuando los objetos están más bajos en el el horizonte. Como ve, los ADC también añaden un nivel de burbuja (verde) para que estén perfectamente orientados respecto el suelo.

Todo esto es algo parecido a los filtros de luz polarizada que se ponen en las cámaras reflex, que según la orientación del filtro respecto la cámara hace que el color del cielo o del mar sea más intenso, como podemos ver en la siguiente composición de dos imágenes con el filtro de luz polarizada en dos orientaciones distintas. Independientemente de la espectacular playa junto el Cabo trafalgar ¿Qué mitad le gusta más? Pues es la misma playa con una diferencia de segundos.

Para acabar; de la misma forma que los dispositivos ADC van a complicar el tren óptico (apartado siguiente), van a aumentar la focal del sistema, por lo que las imágenes serán un poco más oscuras, pero también más grandes, lo cual no está tan mal. Pero como digo, todo esto que arreglan los ADC puede paliarse en gran medida si intenta fotografiar (apartado 3.12) a objetos que están altos en el horizonte, lo cual no siempre es posible (por ejemplo, Saturno ahora está en la constelación de Aquarius, que no es de las más altas del cielo, y como posee un movimiento tan lento, tarda 30 años en dar una vuelta al sol, durante varios años va a estar en una posición muy baja, a diferencia de Júpiter que está ahora cerca de Aries, alcanzando posiciones casi cenitales).

Como digo, un ADC es una pieza interesante, el programa que vamos a ver de captura planetaria, el ASIAir, tiene una opción para ayudar a configurar su orientación, pero por ahora no me planteo gastar unos 150 euros en esta pieza.

3.8. La limpieza del tren óptico

Le voy a poner un vídeo de una captura mía de Ganimedes eclipsando a Júpiter ¿Qué es lo que más chirría de ese vídeo?

Eclipse de Ganimedes sobre Júpiter Pues sí, lo que más chirrían son esos artefactos de la imagen que no dejan de fluctuar (y aunque se quedaran quietos también molestarían). Son unos artefactos que estropean notablemente un vídeo Ahora bien ¿de donde vienen?

Pues de falta de limpieza en el tren óptico (el conjunto de lentes y espejos por los que pasa la luz en un determinado orden). Le pongo un esquema del Maksutov con el que capté la imagen anterior, que en ese momento tenía conectado una lente Barlow $2.5\times$ y la cámara. Aunque el Maksutov tiene dos espejos internos (de color gris oscuro), no son accesibles y por ello no deberían ensuciarse, por lo que las lentes susceptibles de estar sucias son la entrada principal de luz del telescopio (a), la lente de la Barlow (b), o el sensor de la cámara (c). No hay más lentes que sean accesibles al polvo, la grasa de nuestros dedos...

Tras limpiar con cuidado las lentes (b) y (c), el problema desapareció por completo. Y esto es muy importante; la menor mota de polvo cerca del sensor de la cámara (que haya suciedad o no en la boca del telescopio no es tan trascendente, a efectos ópticos la suciedad molesta mucho más cerca del foco) puede hacer que la imagen se ensucie, lo que como vemos, desvirtúa bastante una imagen planetaria.

En definitiva, para no ensuciar la imagen con artefactos, todas las lentes que estén dentro del tren óptico deben estar impolutas. Supongo que una próxima entrada la dedicaré a la limpieza de las lentes de nuestro equipo.

No confundir la limpieza del tren óptico, en general manchas irregulares, con defectos tras el proceso de procesado de imágenes, en general siguiendo un patrón. Por ejemplo, si miramos la foto siguiente, esas extrañas bandas perfectamente verticales a la derecha de Júpiter no son por un fallo de limpieza del tren óptico, sino de un mal procesado (algún parámetro no estaba bien puesto al hacer el procesado por lotes).

3.9. La montura

Dejamos la parte óptica a tener en cuenta. La parte mecánica también muy importante, aunque para hacer fotografía planetaria no es necesario que la montura de su telescopio sea la mejor de la mejor siempre que sea ecuatorial, incluso no es necesario que esté motorizada, aunque sin duda, cuanto mejor sea la montura mejores resultados y más comodidad para usted. Voy a justificar esta afirmación.

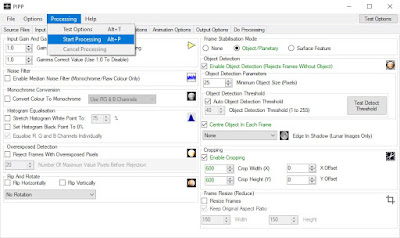

Como veremos más adelante, el programa informático Pipp toma todos los frames de un vídeo y los centra en la imagen, como si el planeta no se hubiera movido del centro de la imagen. Por ello, nos bastaría tomar vídeos en los que el planeta no se salga de la imagen, y para ello bastaría tener una montura ecuatorial perfectamente apuntando a la polar que girando un solo mando siguiera al objeto para compensar la rotación de la Tierra que hace que cambie su posición; entonces iríamos moviendo dicho mando para que el planeta no saliera de la imagen; lógicamente los giros ocasionarían vibraciones y frames a desechar, y el Pipp se encargaría de centrar el planeta en el centro de la imagen.

Bajo este punto de vista, no es necesaria una montura ecuatorial motorizada (y esto justifica mi afirmación anterior), pero sinceramente, una montura ecuatorial motorizada se agradece, y si tiene puerto ST4 para autoguiado, mejor.

Verá, yo tomo mi montura motorizada, y a pesar de que la puesta en estación sea muy precisa, habrá cierta deriva, y el planeta se irá desplazando poco a poco de la imagen, acabando saliendo de la misma al cabo de cierto rato (dependerá de la precisión de su montura y la calidad de la puesta en estación) . Tenga en cuenta que si el disco del planeta se sale mínimamente de la imagen, da igual que la nitidez sea perfecta, ya que lógicamente se descartan los frames en los que el planeta no está completo.

Como decía, habrá cierta deriva, pues resulta que mi cámara y mi montura admiten un cable para guiado por ST4, una vez que conecto la montura a la cámara, cuando el programa de captura detecta que el planeta se mueve por ejemplo hacia arriba, le manda a la montura órdenes para compensar esa deriva, de manera que el planeta se mueva en sentido contrario volviendo al centro de la imagen.

Así, el planeta se mantiene en el centro de la imagen aunque pasen horas, pudiendo nosotros hacer otra cosa, incluso lejos del telescopio. Esto lógicamente es mejor que tener que estar al lado del telescopio dándole a una manivela para que el planeta no se salga de la imagen.

Técnicamente no es necesaria una montura ecuatorial motorizada, bastaría una montura simple (a ser posible ecuatorial para permitir su giro en su eje de AR), pero una montura ecuatorial motorizada con puerto ST4 para autoguiado, se agradece.

3.10. El dispositivo de captura

Es evidente; si vamos a estar capturando vídeos, en algún sitio habrá que guardarlos, por lo que necesitaremos un ordenador conectado a la cámara de captura o una plataforma ASIair.

Un dispositivo ASIair, también de la marca ZWO, es un pequeño ordenador enfocado a la astrofotografía. Se conecta a nuestro móvil por Wi-fi, por lo que desde nuestro móvil tenemos acceso a todo (además de alimentar a otros dispositivos, puede controlar el enfoque, los filtros de color, el rotador de campo, la cámara, hace resolución de placas...) y puede guardar en una memoria interna las fotos o vídeos que vamos capturando, además de disponer de una ranura para tarjetas de memoria.

Estoy interesado en echarle un vistazo más adelante para no depender del ordenador portátil, y poder gestionarlo todo al abrigo de casa mediante WIFI, pero por ahora sólo informo de que esta opción existe, y es un dispositivo que se está extendiendo.

Yo lo que hago es conectar mi portátil a la cámara. En mi portátil tengo instalado el programa que viene con la cámara, y mediante un cable USB conecto la cámara al portátil, de forma que desde el mismo le doy a elegir los parámetros de exposición, inicio o paro las grabaciones...

Más adelante, cuando hable del proceso de fotografiado, describiré el programa que yo uso. Lo importante ahora es que entienda que va a necesitar un soporte para grabar esos vídeos planetarios, ya sea un portátil o un dispositivo ASIair.

3.11. El disco duro disponible

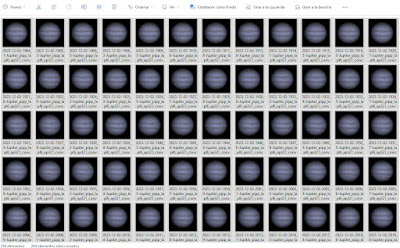

Esta afición sale cara. No sólo en lo económico (montura, tubo, cámara, Barlow, filtros, enfocadores...) sino que además, la fotografía planetaria tira mucho de disco duro. En efecto, para poder tener una foto vamos a tener que grabar un vídeo de un par de gigabytes (gigas). Si nos dedicamos una misma noche a grabar vídeo tras vídeo, al final podemos haber ocupado perfectamente un par de centenares de gigas; no le digo nada si lo que quiere es hacer un timelapse de nubes de júpiter, por ejemplo, y de partida va a intentar grabar uno o dos centenares de vídeos; de partida sabe que va a gastar cerca de medio Terabyte.

No hay solución; la fotografía planetaria es así de cara en cuanto a disco duro; pero tenga en cuenta que mientras un vídeo puede ocupar un par de gigas, una fotografía no ocupará más de una treintena de megabytes (megas; 1Gb=1012Mb, así que una foto de unos 20Mb ocupa unas 100 veces menos que un vídeo de 2Gb), por lo que la sugerencia es que almacene fotos y no vídeos, y para ello, le aconsejo que no tarde mucho en procesar los vídeos para obtener fotos interesantes, y guarde o no esas fotos, borre los vídeos que las generaron.

Este es el camino, borrar cuanto antes los vídeos. No le digo que los borre todos... yo por ejemplo atesoro vídeos que hice de la gran conjunción (de Júpiter-Saturno; diciembre 2020) que no los voy a borrar nunca porque se corresponden a algo irrepetible, pero el resto de vídeos para nada son imprescindibles.

Intento procesar rápido, y si una noche hubo buen seeing y los vídeos salieron buenos, pues seguramente guarde uno o dos vídeos de esa noche (igual en un futuro sacan una herramienta más potente de procesado), pero no más.

Así que aquí tiene algo más a tener en cuenta; la fotografía planetaria sale cara en cuanto a disco duro, así que procese rápido y borre pronto los vídeos.

Otra cosa a tener en cuenta es la siguiente; si piensa hacer un timelapse, es más que recomendable pasarle a sus vídeos el programa Pipp (lo veremos más adelante), por lo que de cada vídeo tendremos otro más, esto es, estaremos duplicando el consumo de disco duro.

De todos modos, como veremos, el pasarle el Pipp a un vídeo no lo fastidiará, sino que ordenará los frames por calidad, centrará el planeta, recortará... Una vez que pase el Pipp y compruebe que el recorte ha sido adecuado y nos e ha quedado sin planeta, puede borrar los vídeos originales y quedarse con los del Pipp, por lo que esta duplicación de vídeos será algo muy temporal.

3.12. Apunte alto, pero ojo al cambio de meridiano

Sin duda usted habrá observado que un día sin nubes el sol en el cénit o cerca de él es imposible de mirar sin dañarnos los ojos (no haga la prueba). Sin embargo, a medida que va perdiendo altura lo que era amarillo se convierte en naranja, y quizás justo antes de ponerse sí pueda mirarse sin riesgo para nuestros ojos.

¿Es ese un raro capricho solar? No. La explicación es que si miramos al horizonte, la capa de aire es mayor que si miramos al cénit, y quien dice aire dice polvo en suspensión y otras partículas, y por eso a veces el sol queda domesticado poco antes de ponerse, mientras es invencible en el cénit.

Conclusión... la mejor fotografía planetaria la hará con planetas que estén cercanos al cénit, porque la capa de aire es menor, y a medida que los planetas van perdiendo altura, la capa de aire entre los planetas y nosotros aumenta, y la fotografía es peor.

Por ello, si puede, en la vida y en la fotografía planetaria, planifique y apunte alto, aunque tenga cuidado, eso sí, de los cambios de meridiano (véase el final del apartado 4.7), especialmente si la noche está siendo muy buena para las fotos y usted no quiere cortar la sesión, no vayamos a tener un disgusto.

3.13. El apuntado por el buscador debe ser perfecto

Los tubos con una focal alta y un campo de visión pequeño tienen un buscador auxiliar con la ventaja de que su focal es muy baja y pillan mucho campo de visión. Estos buscadores suelen tener una cruceta que marca su centro exacto, y sirven para hacer la puesta en estación o búsquedas posteriores.

Así, si el tubo y el buscador apuntan al mismo sitio, para llevar una estrella al centro del tubo (ya me entiende), una estrella que seguramente quedará fuera del tubo con su campo de visión reducido, lo que haremos sea llevar la estrella al centro del buscador ya que esa estrella que está fuera del tubo sí estará dentro del buscador.

Si el buscador y el tubo no apuntasen exactamente al mismo sitio, con el tubo apuntaremos a un objeto terrestre lejano (yo desde mi casa me puedo permitir el lujo de apuntar al famoso Ventorrillo del Chato), y una vez centrado algo que sea inconfundible (una ventana, una letra de un letrero, una farola...) miraremos por el buscador y tocaremos unos tornillos en éste para que buscador y tubo miren al mismo sitio.

De esa manera, cuando buscador y tubo apunten al mismo sitio y quiera llevar algo al tubo, se ayudará del buscador, y cuando ese objeto esté dentro del buscador, estará dentro del tubo.

Pues, y de ahí este apartado, los planetas son como estrellas, ocupan muy poco espacio dentro del tubo, y seguramente aunque hagamos un GOTO a un planeta con la cámara de planetaria ya puesta, quede fuera del campo de visión de la cámara. Los GOTOs por desgracia no son perfectos, y en este caso los planetas son muy pequeños.

Entonces tendremos que tirar del buscador, llevando el planeta al centro del mismo. Si el buscador y el tubo miran al mismo sitio, en seguida el planeta aparecerá por pantalla, pero si no es así, el buscador no le valdrá para nada (si se trata de buscar un objeto grande como una galaxia, nebulosa, la luna... ningún problema, pero ya le digo que el planeta es como una estrella), y le costará mucho trabajo encontrarlo.

Por ello, el apuntado del buscador debe ser perfecto y debe mirar a lo mismo que mire el telescopio, ya que para localizar el planeta al poner una cámara que posee muchos aumentos y muestra un campo de visión muy pequeño, su herramienta para apuntar es el buscador.

3.14. El tiempo de aclimatado del tubo

Esto, por suerte, no cuesta dinero... sólo tiempo. Hay varios tipos de tubos; los reflectores están abiertos, por lo que son como una caja sin tapa, y suelen coger bastante rápido la temperatura ambiente (y una cosa muy importante, tras acabar de observar y guardarlo es conveniente dejar el tubo abierto para que ese frío de la noche se pierda, seguramente por medio de condensación, pero sin la tapa de plástico protectora para que esa humedad se vaya. Si deja la tapa de plástico cerrada, condensará igualmente, pero la humedad se quedará dentro, pudiendo coger hongos).

Pero mientras los reflectores están abiertos, los refractores y los Maksutov están cerrados, y en la apertura principal hay una lente o un cristal. Si sacamos estos tubos, especialmente los Maksutov al cielo nocturno, la capa de aire interna del tubo que viene de estar dentro de casa estará a una temperatura superior a la del aire exterior, lo cual creará una turbulencia añadida. Por ello, se recomienda dejar este tipo de tubos un rato a temperatura ambiente antes de comenzar a fotografiar, para optimizar los resultados cuando el aire dentro y fuera del tubo tengan la misma temperatura. Este tiempo será mayor cuanto más grande sea el tubo, y si por ejemplo para un MAK180 se recomienda cerca de una hora, para los afortunados que tengan un C14 pues un par de ellas (sí, un par de horas de aclimatación).

3.15. La humedad del ambiente

Esto es algo que puede o no pasar, pero que se ceba especialmente con los tubos cerrados (aunque también afecta a los reflectores). Una noche puede ser perfecta para la fotografía planetaria pero puede hacer una humedad terrorífica, y si encima estamos apuntando al cénit para mejorar resultados, en cuestión de minutos podemos tener el cristal o la lente de la apertura del tubo con una capa de humedad en condensación que haga imposible la fotografía planetaria (es como tener cataratas en los ojos).

Hay dos opciones; recoger el equipo o usar unas cintas calentadores o dew heaters. Estas cintas poseen una resistencia interna, y una vez que se las alimenta de corriente, permanecen calientes, haciendo que el vidrio de la entrada de luz de nuestro telescopio permanezca también caliente y la humedad no condense en la entrada.

Si su tubo es grande, puede complementarse con unos parasoles que recubren al tubo y a la cinta calentadora para ayudar a mantener el calor, o incluso, más caros, parasoles ya calefactados.

A estos dew heaters también se les llama anillos anti-rocío o calentadores de rocío, y son muy útiles, ya que pueden salvar una noche húmeda.

3.16. El enfoque

¡Ay del enfoque! Todo lo anterior es muy importante, pero dejo para el final algo que es clave. Ya puedo tener la mejor noche, el mejor tubo, la mejor cámara... que como no acierte al enfocar, mi trabajo no valdrá para nada.

La técnica del lucky frame o lucky imaging parte de que algunos frames serán buenos, pero si el enfoque es malo, en los breves momentos sin turbulencia en vez de capturar imágenes medio nítidas capturaré imágenes borrosas, y al apilar lo que obtendré será una imagen borrosa.

Mucho cuidado con el enfoque; préstele toda la atención del mundo, porque puede convertirse en su peor enemigo.

Imagínese si es un concepto delicado que conviene revisar el enfoque de vez en cuando, ya que a medida que la noche avance y la temperatura seguramente baje, lo que era un enfoque óptimo seguramente se estropee, ya que su tubo y su mecanismo de enfoque son metálicos, y los metales tienen el curioso hábito de contraerse con el frío, por lo que lo que era perfecto a 20ºC no lo será a 18ºC.

Otra dificultad del enfoque es que como hay seeing, el planeta de por sí no se queda quieto, por lo que tendrá que enfocar mientras el planeta se pone mejor y peor, no siendo fácil ver si estas mejoras o pérdidas se deben a haber movido la ruedecita o no.

Es más, al girar la rueda de enfoque, por mucho cuidado que ponga, va a suponer vibraciones al tren de enfoque, por lo que la imagen se moverá de un lado al otro gracias a sus dedos.

Este es un tema fundamental donde los haya y delicado como él solo. Le doy un par de trucos para que lo mejore al máximo.

El primer truco es que el telescopio, sobre todo si es un Newton o reflector, esté perfectamente colimado; si está descolimado de por sí no va a enfocar óptimamente.

El segundo truco es que use la Luna (lógicamente si es visible y a ser posible cercana), cerca de su borde. la luz que llega de los contrastes de luz y sombra de sus cráteres es más estable que la de un planeta, y aunque la Luna esté mucho más cerca, si enfoca bien la luna, los planetas quedarán bien enfocados.

Esos son los trucos, ahora vienen dos herramientas técnicas y seguir sumando gasto a esta maravillosa afición

3.16.1 - La máscara de Bathinov

La primera herramienta es usar una máscara de Bathinov o similar. Una máscara de Bathinov es una estructura de plástico o aluminio que se pone sobre la apertura principal del telescopio. Si apuntamos a una estrella brillante con la máscara puesta, ya no veremos los puntos de las estrellas, sino un patrón de líneas de difracción. Una vez que tocando la rueda del enfocador esas líneas son perfectamente simétricas, el foco es perfecto. En siguiente gif me detengo algo más en la posición de foco perfecto.

Ahora bien; cada tubo posee su propia máscara (que tiene en cuenta aspectos como la apertura, la distancia focal, si hay espejo secundario que obstruye...). Si no encuentra la de su tubo, hay una aplicación que genera la máscara según sus especificaciones, y después puede llevar la imagen a algún amigo que trabaje en impresoras 3D y se la impriman.

Por ejemplo, para mi MAK180 no había máscara de Bathinov en el mercado, pero la diseñé yo, y se la llevé a unos amigos muy enrollados que trabajaban en impresión 3D, y este fue el resultado.

Puede encontrar un generador de máscaras en el siguiente enlace, con una máscara ya generada para las especificaciones solicitadas (coincide con la anterior). El archivo gráfico puede descargarse, y como le digo, algún amigo curioso que trabaje en impresión 3D se la podría imprimir

La máscara de Bathinov (si está bien elegida) es sencillamente una herramienta comodísima para encontrar el foco perfecto en cuestión de segundos, además que le quita a usted de dudas... según la máscara el foco perfecto es éste, no toque el enfoque más.

3.16.2 - Los dispositivos EAF

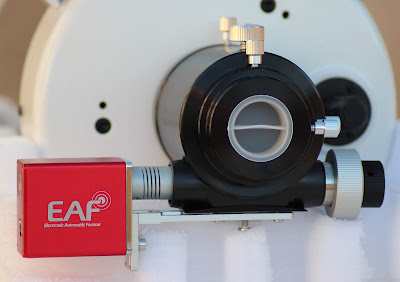

A pesar de que tengo una máscara que funciona, me he decidido probar un sistema de EAF (Electronic Auto Focusser), o sistema de enfoque automático electrónico. Tiene la ventaja de que conectado al PC o similar, por medio de un motor interno toma el control del enfoque, y él sólo en cuestión de segundos encuentra el punto de foco perfecto y deja el recorrido de enfoque bloqueado. Le muestro una foto de mi dispositivo EAF recién instalado (ahora habrá que probarlo cuando la noche lo permita)

Las máscaras de Bathinov y los EAF son dos herramientas útiles para el enfoque en planetaria, como digo, un aspecto fundamental al que no conviene subestimar, y especialmente si la temperatura nocturna va bajando.

Estos son los detalles técnicos que veo que debería tener en cuenta a la hora de hacer fotografía planetaria.

4. El proceso de fotografiado

Ya he descrito todos aquellos aspectos que considero importantes para hacer la fotografía planetaria. Convendría tenerlos atados. Ahora viene el momento clave, el cómo aprovechar una buena noche para fotografiar (en realidad, tomar vídeos). Le voy a decir en qué orden hago yo las cosas.

4.1. La configuración adecuada del equipo

Lo primero que he de hacer es tener el telescopio puesto adecuadamente en estación. Si no fuera un telescopio motorizado pero sí con montura ecuatorial, haría un apuntado del eje de AR lo más preciso al PNC (Polo Norte Celeste), elegiría un objeto y comprobaría si manualmente con la palanca de AR podría seguir dicho objeto durante una cantidad razonable de tiempo.

Mi configuración de trabajo con una montura motorizada es más completa; se la muestro y la describo.

Supongo que la montura está trabajando bajo el mando Synscan (es lo habitual que trae una montura motorizada), pero también podría estar haciéndolo mediante la plataforma ASCOM (esto es más elaborado, hay que buscar otros cables y configurar).

Tengo el buscador estelar perfectamente cuadrado con el tubo, de forma que ambos apuntan al mismo lugar y para poner un planeta en el campo de visión de la cámara si el GOTO no ha sido perfecto, me basta con poner el planeta en el centro del buscador.

Tengo la cámara de fotografiado en el ocular del tubo principal. Dicha cámara puede tener accesorios como un EAF, una rueda de filtros... que no indico en el esquema. Lo que sí indico es que el ordenador se conecta a la cámara mediante un cable USB 3.0, y si mi montura dispone de un puerto ST4 para guiado, la cámara la conecto a dicho puerto mediante un cable RJ12. Ello me permitirá (lo describo más adelante) que el planeta no se salga de la pantalla.

En la fotografía planetaria no es necesario el tubo auxiliar para guiado, el guiado lo haremos mediante el puerto ST4 y el propio programa de captura.

Si la noche es húmeda, le añado al tubo la cinta calefactora y su parasol.

Si el tubo requiere aclimatación, intento sacarlo nada más anochecer y lo dejo sobre la montura para que se vaya aclimatando mientras hago la puesta en estación y configuro el equipo.

Esa es la configuración física del equipo. Por supuesto, si la noche es fría me abrigo convenientemente, preparo la cena a los niños antes de ponerme a trabajar (después todo toma más tiempo del previsto), y similares. A continuación comienzo la rutina del fotografiado.

4.2. Instalo los aditivos a la cámara

Si vamos a usar un filtro de color para resaltar detalles de un planeta, o vamos a usar una lente Barlow, éste es el momento de añadirlos a la cámara, para tras el paso siguiente no tocarla más. Ojo a las lentes Barlow; está muy bien verlo todo más grande, pero si la noche tiene mal seeing, seguramente empeoremos las imágenes.

Una opción que puede tomar es, si no está seguro del seeing, es empezar sin la lente Barlow, comenzar a fotografiar, y si ve que la noche es buena y que al ver el planeta en la pantalla del ordenador éste apenas se mueve, entonces repetir los pasos 4.2., 4.3, y 4.4 para ponerla.

O todo lo contrario. Si piensa que el seeing es bueno, comenzar poniéndola y si ve que el planeta se mueve demasiado, quitarla y repetir los pasos 4.2., 4.3, y 4.4. Al no ponerla todo se verá más pequeño, pero también las turbulencias se notarán menos.

4.3. Abrimos el programa de captura de imágenes

Cada cámara fotográfica de astronomía tiene su aplicación de captura de imágenes, pero tampoco es necesaria esta correspondencia, ya que en general las aplicaciones de captura reconocerán nuestra cámara y ya está. Algunas aplicaciones de captura de imágenes planetarias son:

Yo he usado las tres primeras y me ha ido bien, aunque Sharcap no era gratuita del todo (hace ya tiempo que no las uso, pero la opción gratuita no tenía todas sus posibilidades). Mientras comprobaba los enlaces de las aplicaciones, me ha gustado la página de APT, se ve muy completa, y la última, Backyard EOS, es para cámaras Canon o similares (por eso lo de EOS) para astrofotografía en general, y no es gratuita.

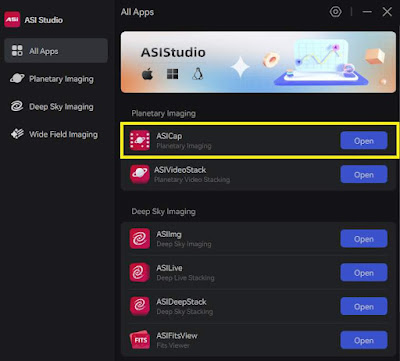

La que he visto más recomendada en foros es Firecapture. Esta creo recordar que sí era gratuita, y a mí no me fue mal con ella, detectando sin problemas mi cámara ZWO. Pero por eso mismo, yo llevo tiempo trabajando con ASIStudio, me va bastante bien con mis cámaras ZWO (es la aplicación propia de éstas cámaras), y es la plataforma de captura que voy a describir, aunque todas las aplicaciones hacen básicamente lo mismo.

En mi ordenador tengo instalada la aplicación ASIStudio, que puede descargarse gratuitamente de la página oficial de ZWO

Igualmente debe estar instalado el driver de su cámara, pero con una conexión WIFI esto no sería un problema; al ejecutar la aplicación con la cámara conectada la detectaría e instalaría sus drivers de la página principal.

(Yo ciertamente echo en falta para elaborar esta entrada que hubiera una cámara virtual ZWO que me permitiera desde este ordenador a pleno día, simular la aplicación para poder hacer capturas de pantalla y describir su funcionamiento y no obligarme a hacer las capturas de pantalla con el portátil conectado al telescopio y por la noche. Esa cámara virtual permitiría practicar con los parámetros de captura desde el salón de casa, y alguno de los programas anteriores sí lo traía, y en el PHD2 estaba bastante currado. En fin, les haré una sugerencia a los de ZWO).

Una vez que pinchamos en dicho icono, se nos abre la aplicación ASIStudio

Vemos que posee varias opciones, encaminadas a la fotografía planetaria (las dos primeras) y a la fotografía de cielo profundo (las 4 últimas). Le doy a la opción marcada en color amarillo, ASICap.

En un principio está todo desactivado. Si tengo la cámara conectada al ordenador, debería leerla, de manera que si le doy al símbolo de PLAY en el centro, la página debería cobrar vida.

Dicho y hecho, al darle a PLAY me salen ya varias opciones para ir marcando.

Buscamos un objeto para llevarnos a la pantalla, ya sea una estrella para el enfoque o el planeta para buscar su orientación óptima o incluso el fotografiado. Para buscar objetos y que aparezcan en la pantalla nos aseguramos de que la RESOLUTION sea la más alta posible (esto es, que la ventana sea en píxeles lo más grande posible; si tira un dardo a una diana es más fácil acertar a la diana completa que a una determinada casilla). Mi cámara me da un tamaño máximo de ventana de 1936*1096, así que lo dejo así.

Si al hacer el GOTO con el SynScan el objeto, estrella o planeta, no aparece en pantalla, use el buscador auxiliar del tubo, que debe estar perfectamente centrado con el mismo. Al llevar el objeto al centro del buscador, el objeto debería aparecer en la pantalla. Pero la primera vez que arrancamos el programa esa noche puede que el objeto esté desenfocado, o que se vea demasiado poco brillante, o todo lo contrario, quizás sobre-expuesto. Vamos a corregir esto.

Me interesa especialmente el rectángulo de opciones de abajo a la derecha, el histograma, la exposición y la ganancia. Ello hará que un planeta o estrella se vea bien, ni invisible (no se vea), ni sobre-expuesto.

Para la exposición, verá que hay como varios escalones relacionados con el mismo. Elegimos aquel escalón que mejor nos venga (para la Luna el tiempo será pequeño, para un Júpiter y Venus algo mayor, para Saturno sensiblemente mayor...).

Es cuestión de ir probando; una vez elegido el escalón movemos la barra de la exposición de manera que veamos el planeta o la estrella de manera correcta, con detalles o forma circular, sin saturar.

Lógicamente, a mayor tiempo de exposición para cada frame, menos frames se podrán grabar por segundo, y en una misma cantidad de tiempo, el vídeo tendrá menos frames. Una herramienta que nos ayuda es la ganancia (GAIN), que funciona como la ISO. Al aumentar la ganancia aumentará mucho el brillo, por lo que podrá disminuir algo la exposición y ganar más frames por segundo.

Pero la ganancia tampoco se puede subir al infinito o la imagen quedaría muy desvirtuada. Aquí se trata de tocar para establecer una exposición lo más pequeña posible con una ganancia moderada.

Una vez que el programa de captura está abierto y nos muestra en pantalla lo que nos interese, ya estamos en condiciones de dar los siguientes pasos; orientar y enfocar. Tras los mismos volveré al programa de captura viendo todo lo que necesitamos saber.

4.4. La orientación

Piense en Saturno... ¿le gusta verlo con los anillos en horizontal o en vertical. Igual para Júpiter y sus satélites.

Seguramente que en vertical no, pero tampoco en horizontal y quizás un pequeño ángulo le venga bien. Esta es una decisión suya, y aunque programas de ordenador puedan hacer una rotación para ajustar este aspecto, si grabamos el vídeo con la orientación correcta, como que mejor.

Entonces, lo que vamos a hacer, ANTES de enfocar, es irnos al planeta, tenerlo en pantalla del programa de captura, y girar la cámara respecto el porta-ocular del telescopio, para que el planeta posea la orientación que más nos guste en la pantalla de dicho programa. Es posible que con este giro el planeta se salga de la pantalla, por lo que es conveniente que la cámara nos dé el mayor campo posible (después explicaré como funciona la cámara)

Para ello, me voy al tubo, miro la pantalla del ordenador mientras aflojo el tornillo que aprieta la cámara al porta-ocular, giro la cámara, encuentro la orientación deseada y vuelvo a apretar el tornillo de la cámara.

4.5. El enfoque

Viene ahora este paso tan trascendente (no tiene sentido enfocar antes si después rotamos la cámara para mejorar la orientación, lo que va afectar el enfoque, y por eso se enfoca después de la orientación; el enfoque no la va a cambiar).

Con un GOTO me voy a una estrella brillante, pero tampoco excesivamente brillante, uso el buscador para centrarla en la pantalla del ordenador, y toco el enfoque para hacer que sea lo más puntual posible . Una vez que tenga el enfoque perfecto, si mi equipo me lo permite, bloqueo el enfocador. Como ayudas para enfocar en este paso.

- Usar el terminal lunar en vez de una estrella brillante

- Disponer de una máscara de Bathinov

- Disponer de un dispositivo EAF

Este es un paso fundamental; los mejores resultados los obtendremos con un enfoque perfecto, si el enfoque es casi perfecto los resultados serán mejorables, y si el enfoque no es bueno nada de lo que vaya a hacer de ahora en adelante quedará bien.

Enfocar no solo es un paso trascendente, sino que conviene repetirlo si la temperatura ambiental va bajando, ya que los equipos, al contraerse su parte metálica por el frio, afectarán el enfoque.

4.5. El fotografiado en sí

Ya tengo la orientación deseada y el foco perfecto. A continuación hago un GOTO al planeta y ahora sí, estamos en condiciones de fotografiar.

Lo primero que debe hacer es establecer en qué carpeta queremos que guarde las capturas, lo que se elige en el recuadro siguiente.

Interesa que sea una carpeta fácil de localizar para usted, y a ser posible en un disco duro distinto del principal, ya que si se llena el disco duro principal el sistema completo de Windows o similar se colapsaría. Por eso yo hago varias particiones del disco duro, en la partición C: de Windows manualmente no guardo nada y le dejo varios centenares de gigas libres para que se encuentre desahogado, y las capturas las hago en otro lugar.

Lo que establezcamos aquí se quedará grabado para siguientes observaciones, por lo que éste es un paso que no habrá que repetir.

Después, tendría en cuenta que el programa automáticamente guarda las imágenes en una carpeta con el nombre del planeta y a partir de ahí, en subcarpetas con la fecha de la observación, por lo que si vamos a observar Júpiter y le decimos al programa que queremos observar Júpiter, todas las imágenes se irían a la carpeta Júpiter, y ello posteriormente nos serviría de ayuda para buscar las imágenes.

Para decirle qué objeto es el que vamos a observar, nos vamos a la rueda de arriba a la derecha y marcamos en la foto del planeta correspondiente. Cada vez que cambiemos de planeta deberíamos repetir este paso.

Nos fijamos, recuadros verdes, que esta rueda de herramientas también nos da acceso a las herramientas de arriba en horizontal.

Ahora si es un buen momento para que si el planeta no aparece en la ventana negra, comience a hacerlo. Para ello tomamos el mando SynScan, y nos llevamos el planeta al centro del buscador. Si el buscador y el tubo apuntan al mismo sitio, debería ser muy sencillo, y el planeta debería aparecer en la pantalla, pero en general no es una tarea tan sencilla, la pantalla negra está mostrando, sobre todo si está trabajando a una focal grande, una parte muy pequeña del cielo.

Una vez que el planeta está en la pantalla, debería estar adecuadamente orientado y enfocado, ya que ya hemos realizado los pasos 4.4 y 4.5. Lo primero que vamos a hacer en el menú de la parte de la derecha, es jugar con Exposure y Gain (tiempo de exposición y ganancia) para que el planeta lo veamos adecuadamente en pantalla. Se trata de darle el menor tiempo de exposición posible con una ganancia que sea moderada. Si vamos a hacer un timelapse, anotamos los parámetros.

Es conveniente para el paso siguiente que el planeta ocupe una posición central en la pantalla (después le daré una herramienta para ello), por lo que tire del Synscan o similar para ello.

Otro parámetro fundamental es el tamaño de la ventana; si nos fijamos en la imagen anterior, el planeta es muy pequeño respecto el fondo. Aunque luego pondré ejemplos, no tiene mucho sentido capturar un fondo tan amplio como vacío, ya que eso va a suponer que capturemos pocos fotogramas por segundo. Lo ideal es que el fondo esté más acorde con lo que de verdad nos interesa, por lo que nos iremos de nuevo a la parte de la derecha, donde pone Image, y elegiremos un tamaño más adecuado. Al cambiar los datos de la barra Resolution vamos a hacer que la ventana ROI (Region Of Interest) se haga más pequeña o más grande.

Si el planeta no está centrado en la imagen inicial puede que al hacer este recorte se salga de la nueva pantalla, ya que ésta por defecto se va centrando en el centro de la pantalla inicial (puede cambiarse).

Después pondré ejemplos de los importantísimos fps, pero obsérvese cómo al tomar un tamaño de ventana de $320\times 240$ en vez del inicial $1936\times 1096$ conseguimos tomar por una parte menos cielo vacío (lo que incrementará los fps), además de verse el planeta más grande. Este aumento es ficticio; con el tubo y la cámara elegidos el tamaño del planeta siempre es el mismo, pero liberamos al programa de que nos muestre toda la ventana y por ello al mostrar una ventana más pequeña, nos muestra el planeta a mayor tamaño. De todos modos, esta ampliación de tamaño puede hacerse también sobre una ventana más grande como veremos a continuación.

Si hace falta, sobre este planeta más grande volvemos a afinar Exposure y Gain ya que lo veremos todo mejor.

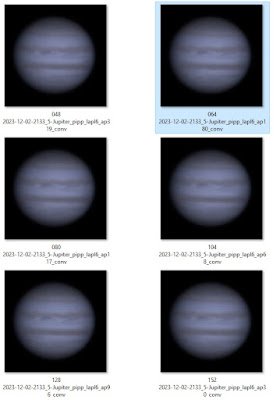

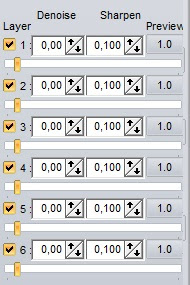

Las opciones del ASIStudio